Das amerikanische Militär erreichte mit KI-unterstützten Systemen eine Rekordzahl von Zielen in kürzester Zeit. Experten befürchten, dass Künstliche Intelligenz das menschliche Urteilsvermögen bei Leben-und-Tod-Entscheidungen überflüssig machen könnte.

Das Szenario autonomer Kampfroboter ohne Kontrolle ist aus Hollywood wie dem Film «Terminator» bekannt. Doch die Realität kommt diesem Bild näher als gedacht, besonders im Iran-Konflikt. Seit KI zunehmend in militärischen Operationen eingesetzt wird, wächst die Besorgnis.

Die amerikanische Firma Anthropic stritt sich mit dem Pentagon nach ihrer Vertragsunterzeichnung 2024 über die Verwendung ihrer KI-Technologie Claude. Nach einer aggressiveren Strategie der US-Regierung im Januar und einem Skandal um Nicolás Maduro wurde die Zusammenarbeit problematisch.

Anthropics Führung wollte ihre Technik nicht für autonome Waffen oder Überwachung einsetzen, während das Militär auf rechtliche Rahmenbedingungen pochte. Michael Horowitz von der University of Pennsylvania betonte in seinen Publikationen, dass keine Armee unkontrollierbare Waffen anstrebe.

Autonomie in Waffensystemen ist seit Jahrzehnten Praxis: Lenkwaffen und Kamikazedrohnen nutzen bereits autonome Funktionen. Der Krieg im Iran zeigt jedoch den beschleunigten Einsatz von KI, um Entscheidungen auf dem Schlachtfeld zu treffen.

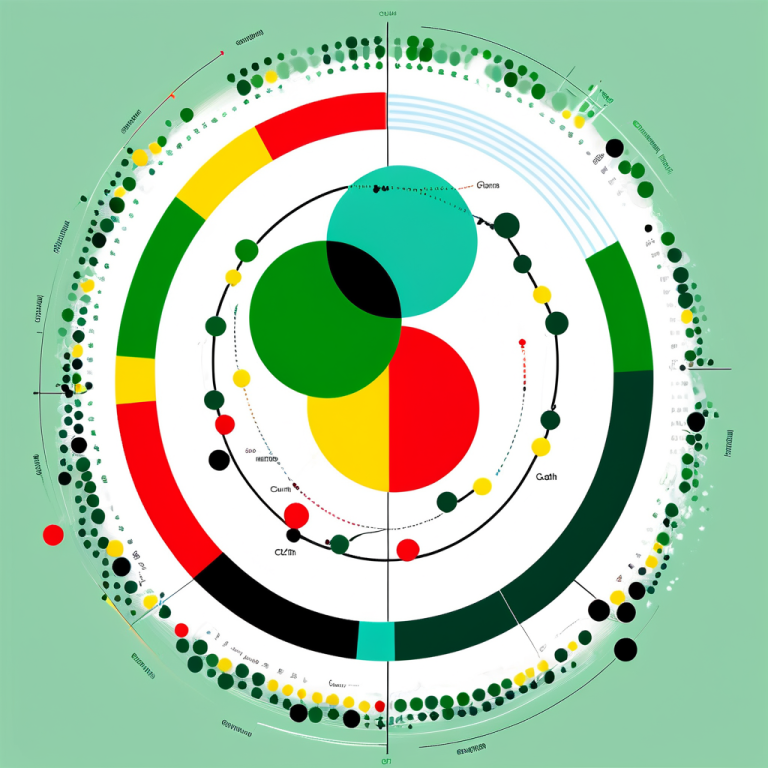

Jessica Dorsey von der Universität Utrecht warnt vor «automation bias», bei dem Menschen maschinelle Empfehlungen unkritisch akzeptieren. Im aktuellen Konflikt zerstörte das Militär mit Hilfe von Claude in 24 Stunden 1000 Ziele, was die Effizienz von KI unterstreicht.

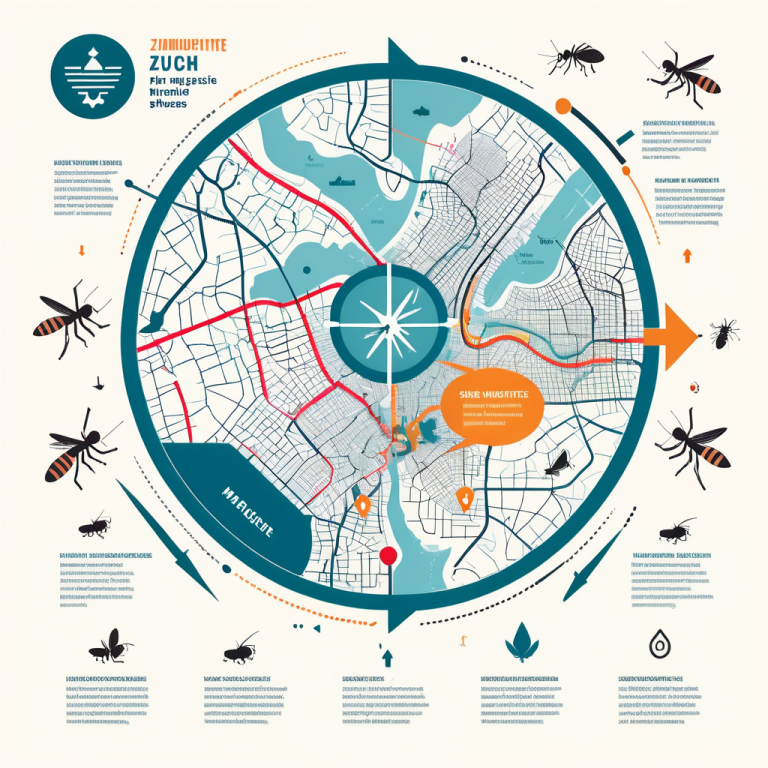

Die Software Maven Smart System des Palantir-Konzerns verkürzt den Entscheidungsweg zum Angriff. Doch eine Schule wurde fälschlicherweise angegriffen; es bleibt unklar, ob alte Satellitenbilder oder menschliche Fehler schuld waren.

KI kann zwar komplexe Daten schnell verarbeiten, sie ersetzt jedoch nicht die qualitativen Entscheidungen des Menschen im Kriegsrecht. Internationale Regelungen sind schwierig zu vereinbaren. Die Konvention über konventionelle Waffen diskutiert seit Jahren ein Verbot autonomer Systeme.

Die Schweiz setzt sich für menschliche Kontrolle bei der Nutzung von KI im Militär ein, stößt jedoch auf Widerstand großer Mächte. Auch beim Gipfel über verantwortungsvolle KI im Militär (REAIM) zeigten sich diplomatische Herausforderungen.

Trotz allem ist Tobias Vestner optimistisch: Nationale Richtlinien könnten die Grossmächte zu einer Regulierung bewegen. Während der Einsatz von autonomen Waffen zunimmt, wird menschliche Rechenschaftspflicht entscheidend sein, um unkontrollierte Killerroboter zu verhindern.