In einer Woche will Nvidia die neuen Chips vorstellen, mit denen es die Führung im KI-Markt verteidigen möchte. Der Konzern steht jedoch zunehmend unter Konkurrenzdruck: Wettbewerber bieten nun wettbewerbsfähige Alternativen an und locken erste Kunden ab.

Am kommenden Montag wird Nvidias CEO Jensen Huang während der Entwicklerkonferenz GTC in San Jose die Vorstellung leiten. Mit diesem Auftritt erlangt der 63-jährige Huang den Höhepunkt seiner Karriere, denn sein Unternehmen hat einen Rekordumsatz von über 200 Milliarden Dollar erreicht und plant für das laufende Quartal eine noch höhere Summe von 78 Milliarden Dollar. Der Gewinn im letzten Quartal betrug beeindruckende 43 Milliarden Dollar, was einer Marge von 75 Prozent entsprach.

Unter Huangs Führung hat sich Nvidia zum wertvollsten Technologiekonzern der Welt entwickelt und dominiert den Markt für Grafikprozessoren (GPU), die parallel viele Berechnungen durchführen können. Insbesondere bei der Ausbildung von KI-Modellen gelten Nvidias Chips aus den Generationen Hopper, Blackwell und Rubin als führend.

Trotz dieser Dominanz wächst der Druck auf Nvidia: Der Fokus in der Branche verlagert sich vom Training hin zur Anwendung des Gelernten – die sogenannte Inferenz. Hierbei handelt es sich um praktische Anwendungen wie KI-Agenten, die eigenständige Aufgaben übernehmen können.

Daher steigt die Nachfrage nach Chips für Inferenzprozesse, die schneller und energieeffizienter sein müssen als bisherige Modelle. Ein Beispiel ist das Unternehmen Anthropic: Sein KI-Agent Claude Code kann selbstständig programmieren und hat eine starke Präsenz in den USA. Für seine Datenzentren setzt Anthropic jedoch auf Chips von Google und Amazon, statt jene von Nvidia zu verwenden.

Dies stellt für Nvidia eine doppelte Bedrohung dar: Neben dem Verlust wichtiger Kunden besteht die Gefahr, dass diese zum Wettbewerb werden könnten. Die Firma ist stark abhängig von ihren fünf größten Kunden – den sogenannten Hyperscalern Amazon, Microsoft, Alphabet, Meta und Oracle, die etwa die Hälfte des Umsatzes mit Rechenzentren ausmachen.

Google und Amazon entwickeln eigene Chips und bieten sie anderen KI-Firmen an. Nvidia hat auf diese Herausforderung reagiert, indem es das Startup Groq übernommen hat. Der Kauf umfasste 20 Milliarden Dollar für die Lizenzierung der Technologie sowie den Eintritt des Topmanagements von Groq.

Weitere Konkurrenten wie das Startup Cerebras und AMD entwickeln Chips gezielt für Inferenzprozesse. So unterzeichnete OpenAI einen Vertrag mit Cerebras, während AMD in einem 100-Milliarden-Dollar-Deal spezialisierte Chips für Meta herstellen wird.

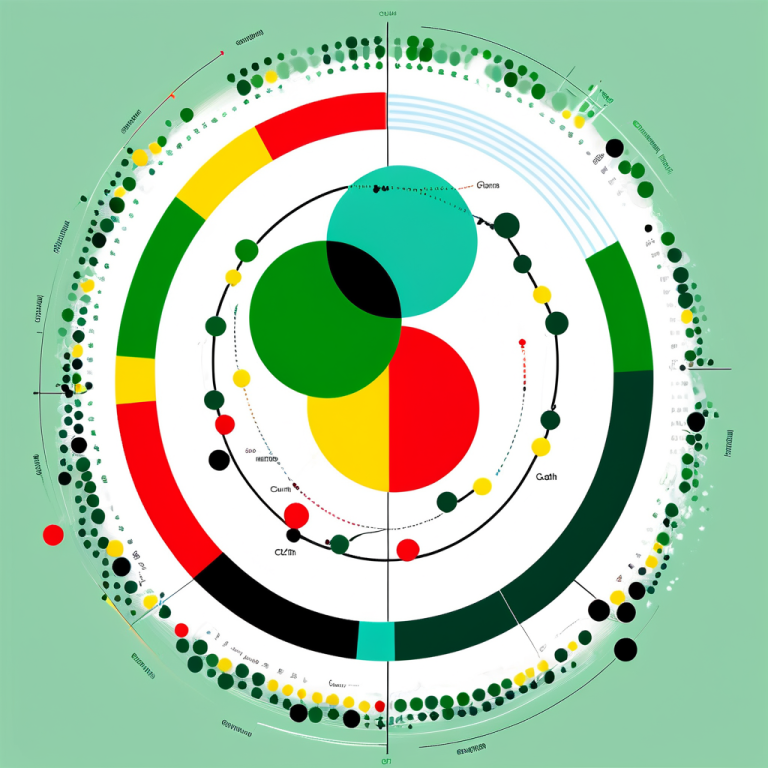

Die Marktforschungsfirma Futurum Group prognostiziert ein schnelleres Wachstum des Marktes für Alternativen zu Nvidia als für Nvidias eigene Produkte. Nun stellt sich die Frage, wie Nvidia Kunden überzeugen will, dass seine neuen Chips für Inferenzprozesse gerüstet sind.

Das Wall Street Journal berichtete kürzlich von einem neuartigen Chip in Zusammenarbeit mit Groq, der auf inferenzfähige Anwendungen ausgerichtet ist. Im Gegensatz zu Nvidias GPUs werden die sogenannten LPU (language processing units) von Groq entwickelt, um den Datenstau zu vermeiden und schneller zu sein.

Zusätzliche Optimierungen in diesen neuen Chips zielen darauf ab, den Datenfluss zu beschleunigen und im Wettbewerb mit immer leistungsfähigeren Konkurrenzprodukten bestehen zu können. Nvidia bleibt Marktführer, aber der Markt ist groß genug, dass selbst kleine Anteile Milliarden wert sind – ein Zeichen dafür, dass sich die Dynamik ändert.