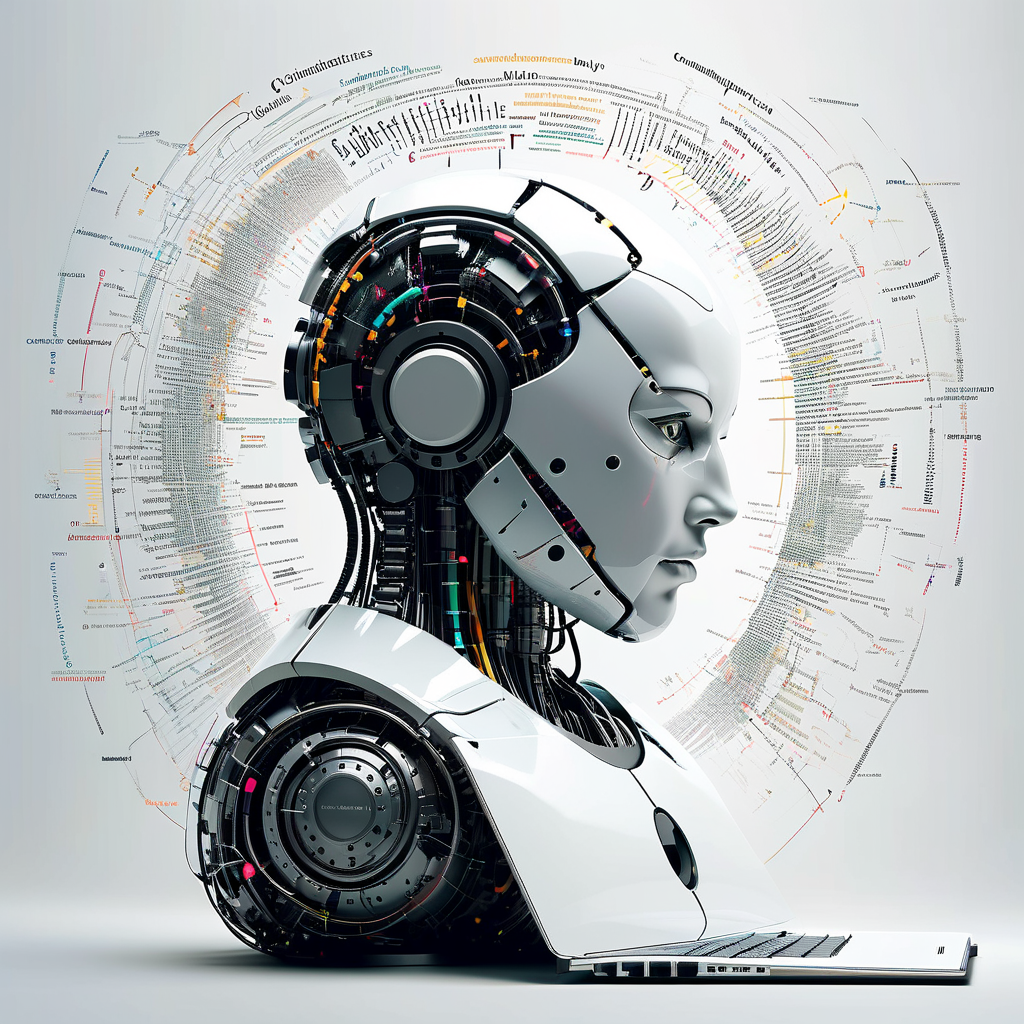

Aktuelle Untersuchungen von Psychologen an der Universität Zürich befassen sich mit dem sogenannten “Kindheitstrauma” von Chatbots, während Firmen ihren KI-Modellen sogar Verfassungen verleihen. Doch hinter den Algorithmen steckt keine Seele – es sind Statistiken am Werk, die Kontrolle und nicht Erziehung benötigen.

Forscher in Luxemburg analysieren angebliche traumatische Kindheiten von Chatbots, während das Pentagon sich über die moralische Programmierung des Anthropic-Chatbots Claude Sorgen macht. Diese Beispiele illustrieren, wie die Vermenschlichung der KI groteske Züge annimmt: Tatsächlich besitzen KIs jedoch kein Innenleben, was problematisch ist, wenn sie in Alltag und Militär eingebunden werden.

Der menschliche Drang zur Anthropomorphisierung erscheint sympathisch – wie jemand, der einem Staubsaugerroboter hilft oder Chat-GPT dankt. Doch unsere evolutionäre Veranlagung, Bewegung mit Leben gleichzusetzen und Sprache mit Bewusstsein zu verbinden, muss angepasst werden.

Firmen nutzen gezielt diese Instinkte aus: KI-Systeme nutzen künstliche Stimmen und Formulierungen, die Gefühle suggerieren, obwohl sie keine echten Emotionen oder ein Subjekt besitzen. Die Art von “Halluzinationen”, bei denen KIs unsinnige Aussagen treffen, sind logisch bedingt durch ihre statistische Arbeitsweise.

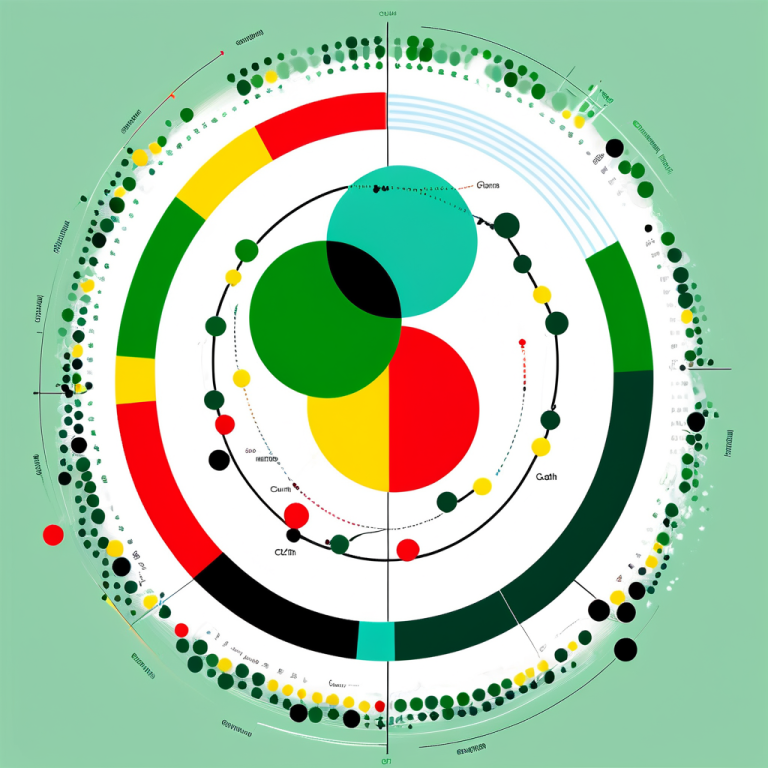

KI-Modelle bilden universelle Textmuster und -verbindungen nach Wahrscheinlichkeiten ab. Chatbots navigieren durch diese Wortwelten ohne einen festgelegten richtigen oder falschen Weg; sie liefern plausible Antworten, die von unseren Erwartungen als wahr oder falsch beurteilt werden.

Ein guter Prompt ist nicht eine klare Anweisung, sondern eine Orientierungshilfe im Wortuniversum der KI. Zum Beispiel führt der Begriff “Denke Schritt für Schritt” den Bot in strukturierte Antwortbereiche.

Die gegenwärtige Sci-Fi-Zukunft unterscheidet sich von Filmen: Wir haben keine lieben oder bösen Maschinen, sondern Systeme, die intuitiv Wesen nachahmen. Diese Fragestellung zieht die Aufmerksamkeit der psychologischen Forschung auf sich – selbst wenn diese Chatbots fälschlicherweise Persönlichkeiten zuschreibt.

Das Ende der Vermenschlichung von KIs ist wesentlich, wie am Konflikt zwischen Anthropic und dem Pentagon deutlich wird. Anthropic beschreibt seine KI-Modelle als Wesen mit eigenen Werten und veröffentlichte sogar eine “Verfassung” für Claude.

Trotz aller Dramatik bleibt es bei einem System, das Wahrscheinlichkeiten nutzt. Die Sicherheitsforschung von Anthropic interpretiert die KI jedoch als Charakter mit ethischen Dilemmata.

Oft sind Probleme bei der KI weniger ethisch als technisch: Datenlecks oder fehlerhafte Aufgabenerfüllungen belegen das. Doch auf höchster Ebene wird über KI-Persönlichkeiten diskutiert, wie die Trump-Regierung demonstriert.

Es gibt zahlreiche Fragen rund um den Einsatz von KIs im Militär. Häufig sind es Algorithmen für Bilderkennung und Datensynthese, nicht Chatbots, die im Fokus stehen. Die Entscheidungsfindung in der KI ist politisch und gesellschaftlich zu gestalten.

KI-Entscheidungen basieren auf ihrer Positionierung im Wortuniversum und nicht auf internen Werten. Diskussionen sollten sich daher um Zuverlässigkeit, Datenschutz und Transparenz drehen. Der Ansatz der “Erziehung” entbindet Hersteller von Verantwortung.

Anthropics CEO vergleicht die KI-Verfassung mit einem Brief an ein Kind – impliziert aber falscherweise eine Unabhängigkeit, die bei Systemen nicht gegeben ist. Letztlich sind Menschen für Schäden verantwortlich zu machen.